电商 618 刚过,而 E5 洋垃圾的价格继续逐步走低,一直想要升级老古董电脑的我,内心深处不断躁动!

看了下面俄罗斯网站的描述,没想到我们的主板还专门被俄罗斯人拿去研究了哈哈!

huananzhi-x99-f8d —— https://xeon-e5450.ru/socket-2011-3/huananzhi-x99-f8d/

xeon-e5-2697-v3 —— https://xeon-e5450.ru/socket-2011-3/e5-2600-v3/xeon-e5-2697-v3/

我实在忍不住了!!!

最终我出手了——花了不到 2000 元,组建了双路 E5 平台,实际使用下来不得不感叹:性价比确实很高!

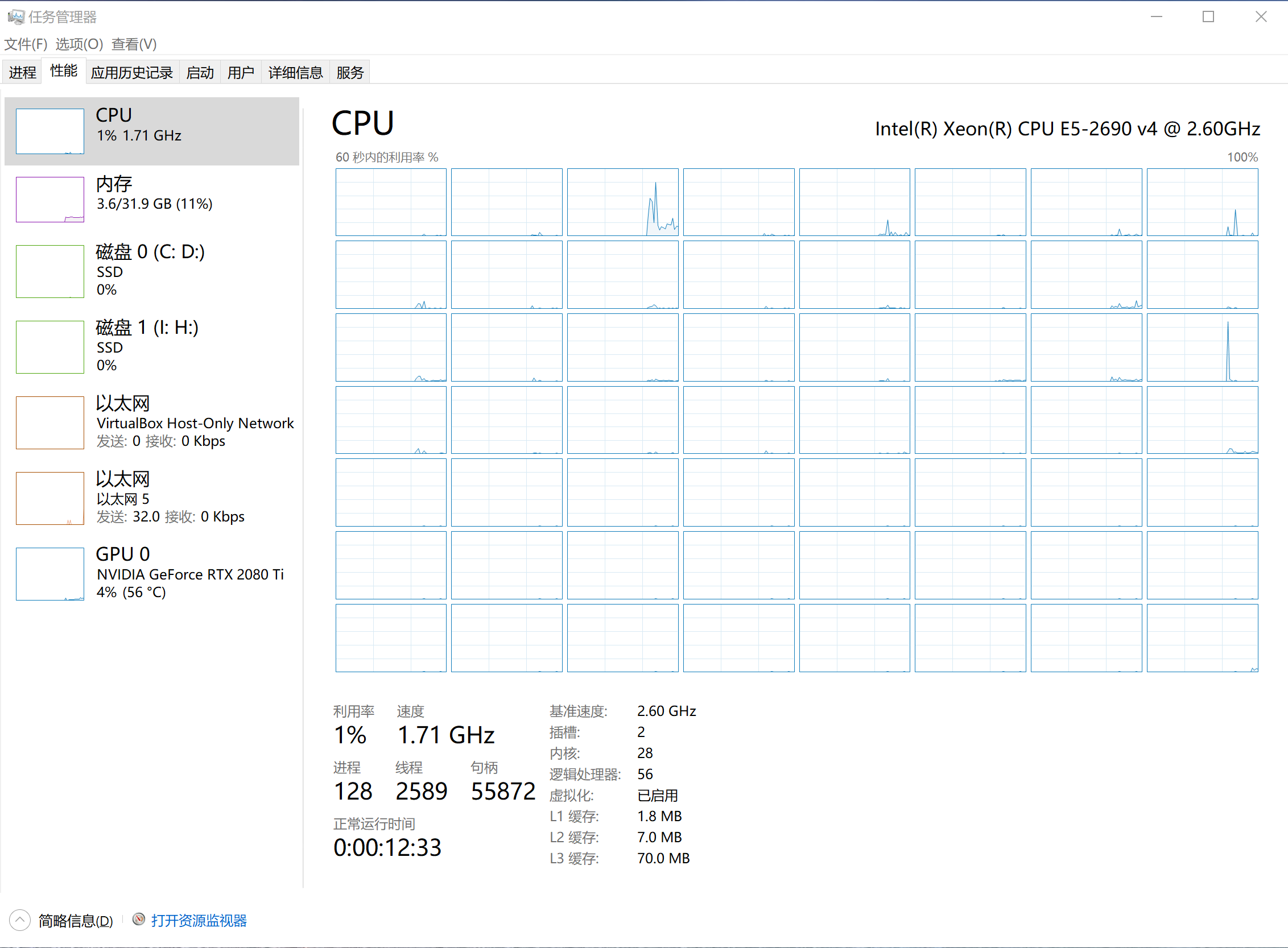

开始之前,我们先来数一下框框:

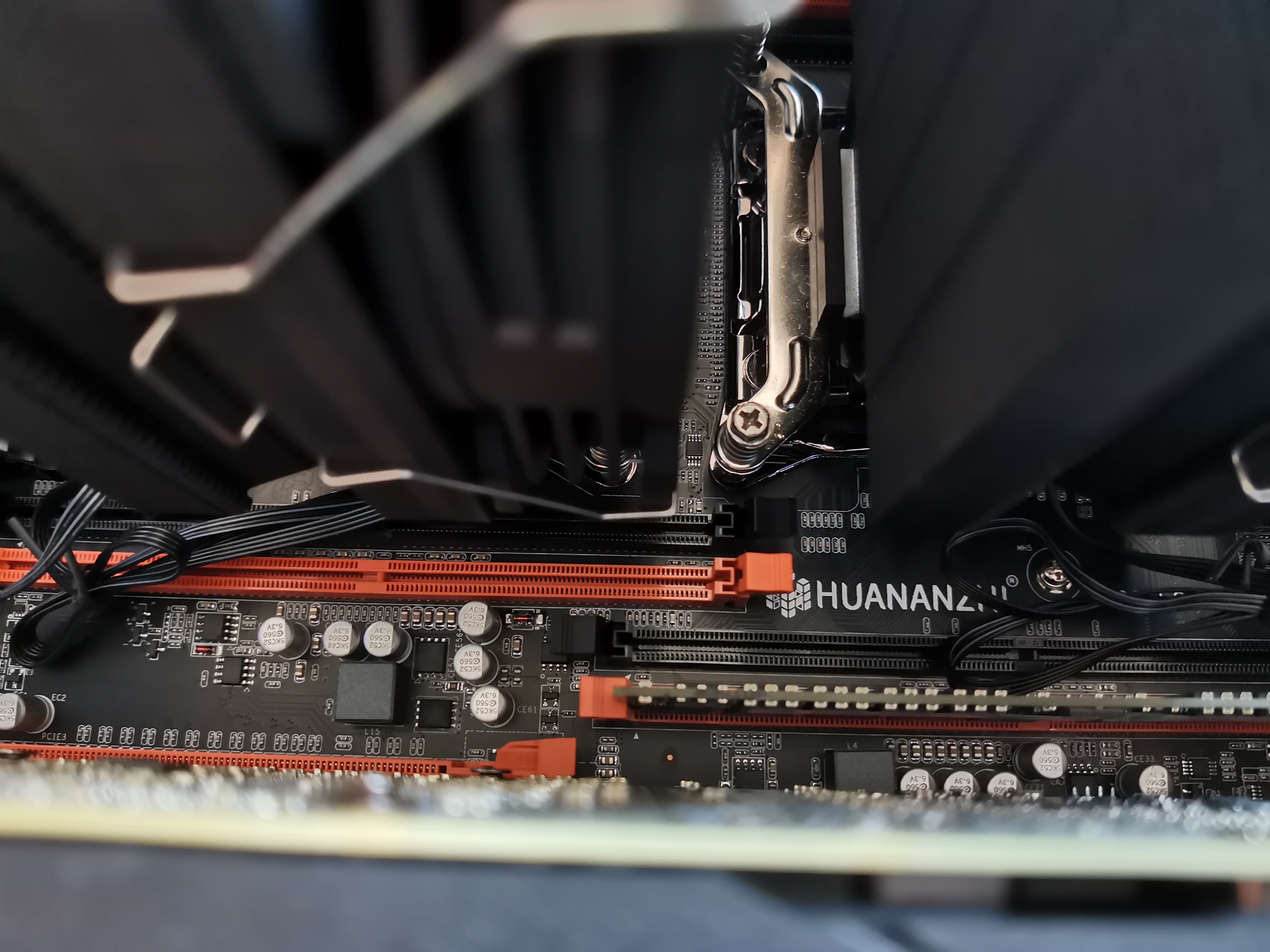

嘿嘿,一共有 56 个框框哦!我的装机方案如下:

CPU:E5-2690v4,共 2 颗

内存:服务器 ECC 16G DDR4 2400,共 2 条

主板:华南 X99-F8D 双路大板

散热器:冰曼纯铜 6 热管 LED 版,共 2 个

显卡:技嘉 RTX2080ti

电源:利民 1000W(ATX3.0)

机箱:大水牛 E-ATX

不算显卡,共花了 2000 多块钱!其中板 + CPU 只要一千出头,DDR4 内存条 2 根共 32G 才 170 块钱……

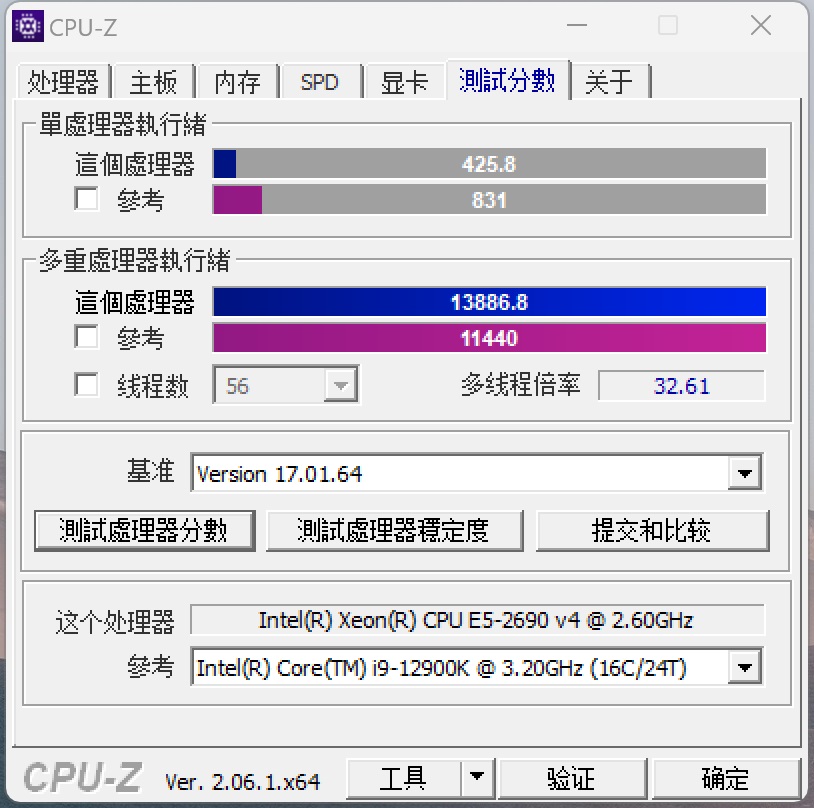

我们看看跑分:

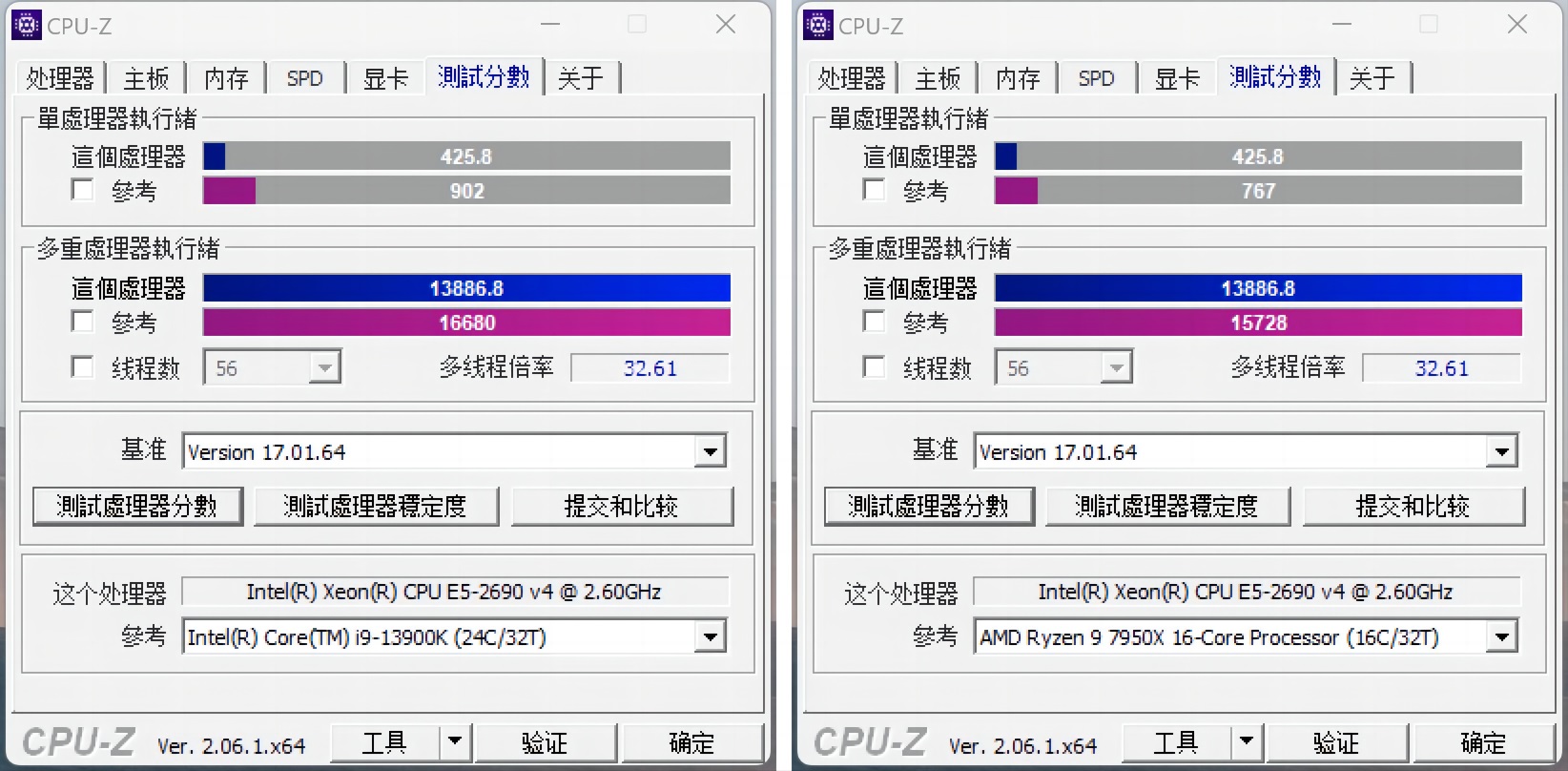

CPU-Z:单核 426 分,多核 13887 分(对比 i9-12900K 单核 831,多核 11440);

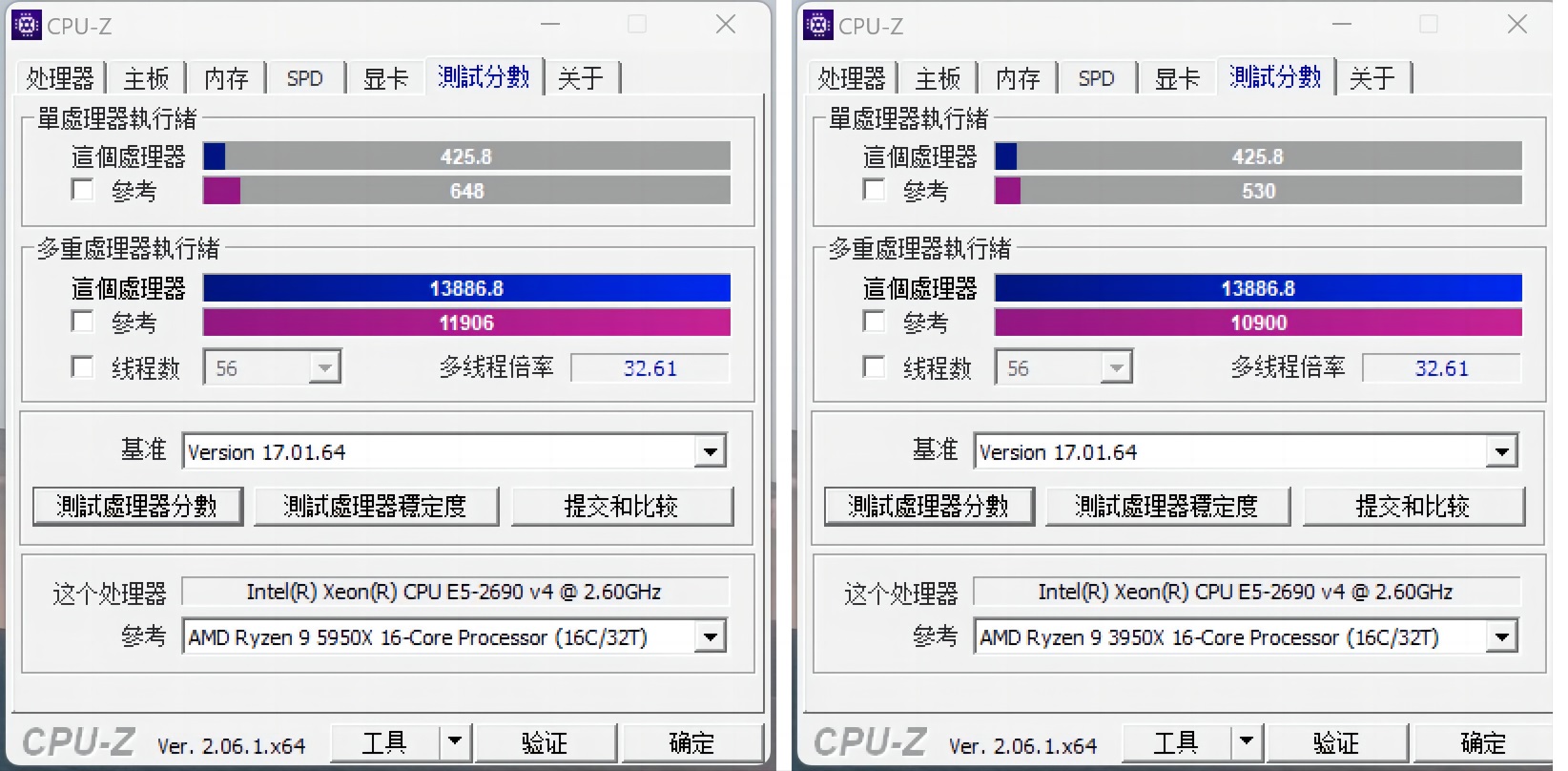

CinebenchR23:

鲁大师:CPU 分数 80 万(对比 i5-10600KF 44 万)

实际玩游戏下来,英雄联盟 4K 分辨率 + 最高画质,帧率 280~320 FPS!泉水 480~520 FPS!对游戏感兴趣的,可以去 B 站搜搜看,许多 UP 主有非常详细的评测。

对比我之前使用 i7-6700 + B150,感受比较深的,就是发热量大!

待机 CPU 在冰曼散热器的压制下,基本都在 35-40 度(现在是大夏天),待机功耗加上显示器 120W 左右,打游戏 60 多度,功耗忘记看了(RTX2080Ti + 最高画质),肯定不低。

但是——

我的 M.2 固态没有散热片,温度直接干到 68 度!得上散热马甲!

使用体验上还是可以明显感觉到快,尽管单核基本上没有太大提升。

E5 真香!E5 真香!E5 真香!

因为我电脑有其它用途,多核对我来说收益很大……

不过坑点也很多,除了刚刚说的 M.2 固态没有散热鳍片之外,买主板和 CPU 和内存,得看好是 DDR3 还是 DDR4,因为 E5 的型号很多!

反正就是特别杂!要考虑哪些性价比高(参考前面发的俄罗斯网站)……

散热器太大,内存条太高也可能安装不了……

如果你是专门打游戏,或者普通办公,建议还是选择市面上主流的平台!

推荐 AMD R5-5600,拼夕夕上板 + U 一千出头,加个 16G 内存条加个电源,都不用 2000 块钱!再搭个 RTX-3060/RX-6600,也够用了。

两千如果比较有压力,确实可以考虑 E5 平台,板 + U + 内存 + 电源, 一千可以拿下,办公 + 打网游也 OK 的。

最后再晒图,感兴趣的可以评论区交流哈哈。